Dari semua kekuatan menakutkan internet, kemampuannya untuk mengelabui orang yang tidak curiga mungkin yang paling menakutkan. Clickbait, foto-foto yang diambil dan berita salah adalah beberapa pelanggar terburuk, tetapi beberapa tahun terakhir ini juga telah muncul kebangkitan alat baru yang berpotensi berbahaya yang dikenal sebagai deepfake artificial intelligence (AI).

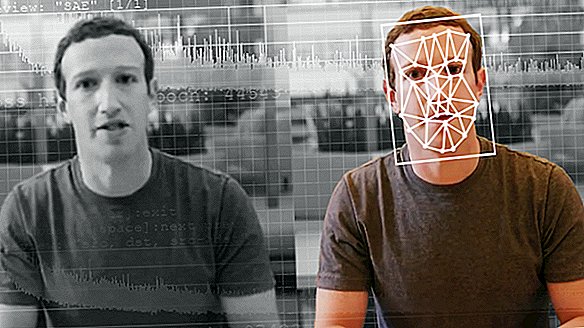

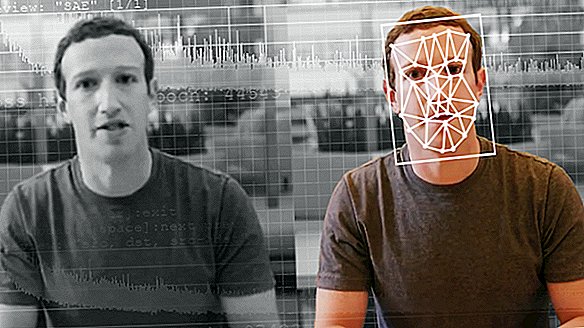

Istilah deepfake mengacu pada video dan audio palsu yang dihasilkan komputer yang sulit dibedakan dari konten asli yang tidak diubah. Ini untuk memfilmkan apa itu Photoshop untuk gambar.

Bagaimana cara kerja deepfake AI?

Alat ini bergantung pada apa yang dikenal sebagai jaringan permusuhan generatif (GAN), suatu teknik yang ditemukan pada tahun 2014 oleh Ian Goodfellow, seorang Ph.D. pelajar yang sekarang bekerja di Apple, Popular Mechanics melaporkan.

Algoritme GAN melibatkan dua AI terpisah, yang menghasilkan konten - katakanlah, foto orang - dan musuh yang mencoba menebak apakah gambar itu asli atau palsu, menurut Vox. AI menghasilkan dimulai dengan hampir tidak tahu bagaimana orang melihat, artinya mitranya dapat dengan mudah membedakan foto yang benar dari yang palsu. Namun seiring berjalannya waktu, setiap jenis AI menjadi semakin lebih baik, dan akhirnya AI yang menghasilkan mulai menghasilkan konten yang terlihat sangat hidup.

Contoh-contoh deepfake

GAN adalah alat yang mengesankan dan tidak selalu digunakan untuk tujuan jahat. Pada tahun 2018, sebuah lukisan buatan GAN yang meniru gaya seniman "Tuan Tua" Belanda seperti Rembrandt van Rijn dari abad ke-17 dijual di rumah lelang Christie dengan harga $ 432.500.

Pada tahun yang sama, deepfake naik ke popularitas luas, terutama melalui pengguna Reddit yang pergi dengan nama 'deepfakes,' Wakil melaporkan. Teknik GAN sering digunakan untuk menempatkan wajah selebriti terkenal - termasuk Gal Gadot, Maisie Williams dan Taylor Swift - ke tubuh aktris film porno.

GAN lain telah belajar untuk mengambil satu gambar seseorang dan membuat foto atau video alternatif yang cukup realistis dari orang tersebut. Pada tahun 2019, sebuah deepfake dapat menghasilkan film-film menyeramkan tetapi realistis dari Mona Lisa yang berbicara, bergerak dan tersenyum di posisi yang berbeda.

Deepfakes juga dapat mengubah konten audio. Seperti dilansir The Verge awal tahun ini, teknik ini dapat menyambungkan kata-kata baru menjadi video seseorang yang sedang berbicara, membuatnya tampak bahwa mereka mengatakan sesuatu yang tidak pernah mereka maksudkan.

Kemudahan penggunaan alat baru ini berpotensi menimbulkan konsekuensi yang menakutkan. Jika ada orang, di mana saja dapat membuat film realistis yang menampilkan selebriti atau politisi berbicara, bergerak dan mengatakan kata-kata yang tidak pernah mereka katakan, pemirsa dipaksa untuk menjadi lebih waspada terhadap konten di internet. Sebagai contoh, dengarkan peringatan Presiden Obama terhadap masa depan dystopian yang "ditingkatkan" dalam video ini dari Buzzfeed, yang dibuat menggunakan deepfake oleh pembuat film Jordan Peele.